«Kunstig intelligens» refererer til maskinens evne til å imitere menneskelige funksjoner og atferd som læring, evnen til å resonnere og generere språk, løse problemer, ta beslutninger – men også til å forstå mennesker, simulere empati og uttrykke «følelser». Dette skjer takket være LLM«store språkmodeller», som takket være trening på milliarder av tekster og samtaler er i stand til å svare på en stadig mer empatisk og personlig tilpasset måte, til det punktet å etablere relasjoner som mange oppfatter som autentiske, på lik linje med mennesker.

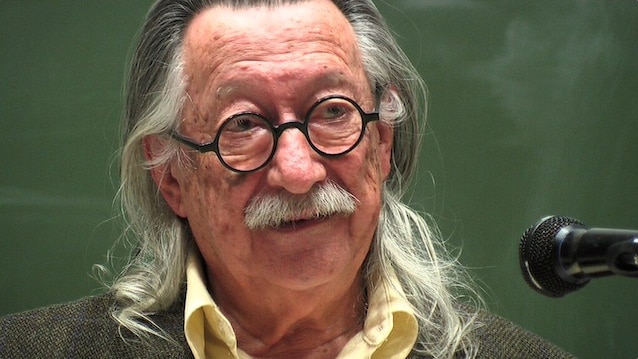

Moderne chatbots ble født mellom 2016 og 2020, men det er med ChatGPT, på slutten av 2022, at de blir en del av hverdagen, og markerer begynnelsen på æraen medGenerativ konversasjons-AIbåde på jobb og fritid: i 2025 har nesten 30 % av italienerne brukt minst ett kunstig intelligensverktøy – i spissen, faktisk, Chat GPT. Hva om vi fortalte deg at den første chatboten dateres tilbake for seksti år siden? Han het ELIZA og det var eksperimentet til en tysk fysiker, Joseph Weizenbaum, som oppfant det i 1966. Forskeren hadde ikke til hensikt å vise hvor «intelligent» en datamaskin kunne være, men snarere det motsatte: han ønsket å fremheve maskinenes grenser i virkelig å forstå menneskelig språk og følelser.

Fødselen og utviklingen av den første chatboten i historien

Etter andre verdenskrig lurte Alan Turing på om maskiner kunne tenke. Tjue år senere, i 1966, den tyske fysikeren Joseph Weizenbaumprofessor ved MIT i Boston, skapte det vi kan definere som den første chatboten i historien, i stand til å presentere seg selv som en ekte person, nærmere bestemt en psykoterapeut som kunne samhandle med sin «pasient».

Tar navnet fra Eliza Doolittleen karakter fra George Bernard Shaws Pygmalion som, takket være fonetikkprofessoren Henry Higgins, klarer å utgi seg som en hertuginne fra en fattig blomsterjente med en sterk arbeiderklasseaksent, ble ELIZA født som en veldig enkel programvare i stand til å gi de som konsulterte den en illusjon av å ha blitt forstått. Dette er takket være omformuleringen av brukerens input, forvandlet til generiske setninger og repetisjoner i form av spørsmål, slik en Rogeriansk terapeut ville ha gjort (fra Carl Rogers tilnærming, sentrert om å fremme pasientens selvbevissthet, å ønske ham velkommen uten å dømme).

Under eksempelet på en samtaleutgitt av Weizenbaum i januar samme år i en artikkel, «ELIZA – et dataprogram for studiet av naturlig språkkommunikasjon mellom menneske og maskin”, publisert i det akademiske tidsskriftet Kommunikasjon til ACMutgitt avAssociation for Computing Machinery (ACM).

Effektene av ELIZA

I Shaws arbeid lykkes Eliza i transformasjonen som Higgins hadde satset på og gjenvinner hennes uavhengighet og menneskelighet, og nekter å bli betraktet som bare et «eksperiment». Også ELIZA var et vellykket, eller kanskje mislykket, eksperiment: Weizenbaum innså hvordan folk i dialog med programmet ble ledet til å åpne seg og utvikle et empatisk bånd, og med overraskende letthet lurte seg selv til at de ble forstått. Målet hans var imidlertid ikke å vise potensialet til disse maskinene, men i stedet å demonstrere at reell forståelse fra deres side var umulig, på grunn av en strukturell grense.

Med ELIZA overføringen mellom lege og pasient som Sigmund Freud hadde lagt merke til skjedde for første gang i en kunstig og datastyrt versjon, og innledet det som senere ble kalt «Eliza-effekten» – og som ble stadig sterkere etter hvert som datamaskinenes samtaleevner utviklet seg. Resultatet av chatboten viste seg allerede den gangen å være så overbevisende at det bekymret skaperen, som vokste opp i Nazi-Tyskland: Weizenbaum var overbevist om at en obsessiv avhengighet av teknologi kunne være et tegn på en moralsk svikt i samfunnetog angret litt på oppfinnelsen som Robert Oppenheimer hadde gjort med atombomben.

Hans hovedanliggende var at datamaskiner ble gitt dom, opptil én delegering av moralske og personlige avgjørelser. I følge Weizenbaum vil databehandling også føre til å begrense personlig ansvar og potensialet i menneskelige relasjoner, og bidra til å gjøre verden mer byråkratisert og konservativ. I stedet for å starte en revolusjon som er i stand til å undergrave undertrykkende maktstrukturer, fryktet vitenskapsmannen at dette ville føre til en kontrarevolusjon som ville styrke dem.

i «Datamaskinens kraft og menneskelig fornuft: fra dømmekraft til beregning» (1976) kritiserte dermed ikke så mye kunstig intelligens, men de systemene designet for automatisk å erstatte menneskelig beslutningstaking. «Avhengighet av datamaskiner er bare det nyeste – og mest ekstreme – eksemplet på hvordan mennesker er avhengige av teknologi for å kunne unnslippe byrden med å handle autonomt«, uttalte han i et intervju med magasinet New Age i 1985. Denne frykten gjorde ham til en «kjetter» og distanserte ham i økende grad fra det vitenskapelige miljøet involvert i studiet av AI.

Chatbots i dag: data i Italia

Plattformdata MyMetrix av ComScore de forteller oss at i april 2025 brukte 13 millioner mennesker i Italia minst én AI-app (28 % av nettbefolkningen). I første kvartal 2025 ble ChatGPT, ifølge «Audicom – Audiweb system»-data, brukt i gjennomsnitt av 7,2 millioner brukere hver måned, det vil si av 17 % av befolkningen mellom 18 og 74 år som bruker internett (med en topp i april på 9 millioner brukere).

Veksten siden 2023 har vært veldig rask: Hvis den i april 2023 ble brukt av 750 000 italienere og i april 2024 av 2,4 millioner, var det mellom april 2024 og 2025 en økning på 266 % – med ytterligere +45 % i årets fire første måneder. Etter ChatGPT er de mest brukte AI-ene Gemini (2,8 millioner brukere i april 2025), Microsoft Copilot (2,7 millioner), DeepSeek (518 000), Perplexity (270 000) og Claude (158 000). Character.AI er neste med 119 000, men brukes i gjennomsnitt 20 timer per måned per bruker, spesielt av unge mennesker og kvinner.

De Pew Research Center gjennomført en undersøkelse om oppfatningen av AI og bruken av den i 25 land rundt om i verden, inkludert Italia, og fant at tilliten til AI er ikke så høy ennå: Generelt er folk 34 % mer bekymret enn entusiastiske, 42 % like bekymret og entusiastiske og bare 16 % mer entusiastiske enn bekymret (ifølge mediandata). De mest bekymrede er USA, Italia, Australia, Brasil og Hellas: i Italia stiger bekymringsnivået til 50 %, med 37 % like bekymring og entusiasme, og bare 12 % av entusiasme.

Elizas arv, nesten 60 år senere

Moderne chatbots har den stadig mer finjusterte evnen til å lære og tilpasse seg brukernes språklige mønstre, så vel som deres individuelle preferanser, og er i stand til å endre svarene dine dynamisk basert på konteksten til samtalene, og dermed tilrettelegge for skreddersydd emosjonell støtte. Hvis den nyeste versjonen av GPT-5 er blant AI-ene med det laveste nivået av sykofantatferd, og gir svar av denne typen bare i 29 % av tilfellene, gjør DeepSeek-V3.1 det 70 % av tiden.

Som allerede demonstrert av den tyske fysikerens eksperiment, er det overraskende lett for oss i dag å overlate våre skjørheter og ønsker til stadig mer personlig AI og be dem om råd om selv ømfintlige spørsmål. Fordi det virker lettere å tilstå til en maskin enn til et annet menneske? Først av alt, AI er alltid tilgjengelig. Videre, i motsetning til menneskene rundt oss, forventer vi at de ikke vil dømme oss, de vil ikke spre våre hemmeligheter og for dette trenger vi ikke å skamme oss.

Ved å lure oss til å tro at vi har å gjøre med noen som er i stand til å forstå oss, forklarer Nigel Crook, direktør for Institute for Ethical AI, chatbots har «evnen til å manipulere mennesker følelsesmessig». Likevel «AI gjør ingenting mer enn å forutsi en plausibel rekkefølge av ord, det er det den gjør. Og han forstår ikke at denne rekkefølgen av ord tilsvarer noe i virkeligheten.»

Jo mer vi stoler på maskiner, desto lettere blir det, som Weizenbaum spådde, å delegere deler av beslutningene våre – og vår frie vilje – til dem.