Sammendragene som genereres av Googles kunstige intelligens, de såkalte AI-oversiktene, det vil si de tekstblokkene som vanligvis vises øverst i søkeresultatene og som automatisk oppsummerer svaret på et spørsmål, de svarer riktig på omtrent 91 % av faktaspørsmålene. Dette virker som et tilsynelatende utmerket resultat, men det skjuler et problem av gigantisk skala. Ifølge noen estimater, noe som mer enn 5 billioner søk per år. De er ikke små moter. Hvis rundt 10 % av disse søkene returnerer feil AI-sammendrag, betyr det hver time titalls millioner svar kan returnere feil informasjon. Dette er langt fra utmerket.

Denne situasjonen er illustrert av en analyse utført av New York Times i samarbeid med Oumi, en startup som spesialiserer seg på kunstig intelligens, som testet Googles system på tusenvis av konkrete spørsmål. Resultatene viser en liten forbedring i nøyaktigheten til svarene som er gitt, men samtidig også en ny kritikk: kildene som er sitert av AI Overview er stadig mindre pålitelige, noe som gjør vanskeligere for brukere å uavhengig bekrefte informasjonen som mottas.

AI Oversikt satt på prøve

Metoden som brukes av Oumi for å teste AI Overviews kalles SimpleQA. Det er en benchmark – det vil si et standardisert evalueringsverktøy – utviklet av OpenAI og mye brukt i industrien for måle den faktiske nøyaktigheten til systemer for kunstig intelligens. På et utvalg av 4.326 søkviste resultatene en signifikant utvikling: med Gemini 2 (modellen i bruk i oktober 2024), de riktige svarene stoppet kl85 %. Med oppdateringen til Gemini 3 (testet i februar 2025) steg prosentandelen til 91 %.

Det virkelige problemet er imidlertid ikke så mye selve svaret, men kildene som følger med det. Oumi fant ut at en betydelig del av de riktige svarene oppdaget i februar var «ubegrunnet». Med andre ord, lenkene som ble sitert til støtte for svaret bekreftet faktisk ikke det som ble oppgitt. I oktober var denne prosentandelen allerede bekymringsfull, den nådde kvoten 37 %men i februar steg det til 56 %. I praksis gir Google et riktig svar i de fleste tilfeller, men sidene den lenker til forklarer det ikke, bekrefter det ikke eller motsier det, og dette i over halvparten av tilfellene. Blant dem mest siterte kilder fra Gemini-sammendragene vises Facebook Og Redditplattformer som absolutt ikke garanterer samme pålitelighet som en journalistisk eller vitenskapelig kilde.

De New York Times dokumentert noen av mer alvorlige feil forpliktet under studiet. På spørsmål om når Bob Marleys hus ble et museum, svarte Google «1987» i stedet for riktig «1986», med kilder som ikke bekreftet datoen som ble gitt. I et søk på Yo-Yo Ma og Classical Music Hall of Fame vendte motoren tilbake til organisasjonens offisielle nettsted, og hevdet imidlertid at musikeren ikke var medlem. I et annet tilfelle var Dick Dragos alder ved døden riktig, men dødsdatoen var feil. Enkelte tilfeller, absolutt, men symbolsk for et tilbakevendende mønster.

Enda mer relevant er en eksperiment utført av en journalist fra BBCsom spesielt opprettet en artikkel med bevisst falsk informasjon og la det ut på nettet. På mindre enn 24 timer hadde Googles oppsummeringssystem allerede absorbert og gjengitt de uriktige rapportene i sine AI-oversikter. Dette fenomenet, kjent som «dataforgiftning» (eller dataforgiftning), viser hvor sårbare automatiske oppsummeringssystemer er for upålitelig eller manipulert innhold.

Googles «dobbelte» svar

Der Googles svar angående problemene i studien vi nettopp nevnte, lot ikke vente på seg. Nettsøkegiganten bestred både metodikken og konklusjonene til studien. Talsmannen Ned Adriance definerte rapporten som full av «alvorlige mangler», som understreker at SimpleQA er en benchmark utviklet av en direkte konkurrent, OpenAI (selskapet som utvikler ChatGPT), og som i seg selv inneholder noen unøyaktigheter.

Google bemerket også at Oumi brukte sine egne AI-systemer for å analysere Googles AI-genererte sammendrag, og potensielt introduserte ekstra margin for feil. Argumenter som ikke er helt ubegrunnede, men som risikerer å høres paradoksale ut: Å hevde at en studie om unøyaktigheten til AI ble utført med verktøy som også er upresise, styrker absolutt ikke tilliten til produktet som forsvares.

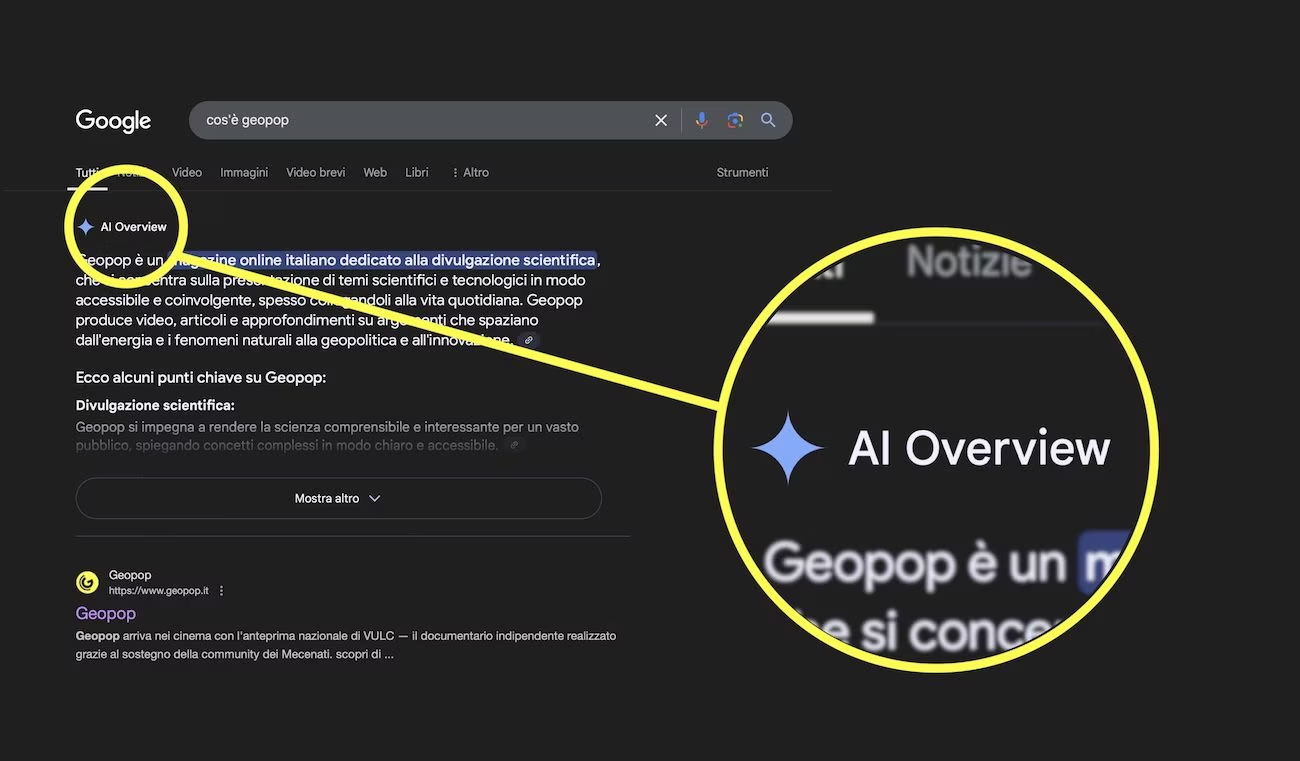

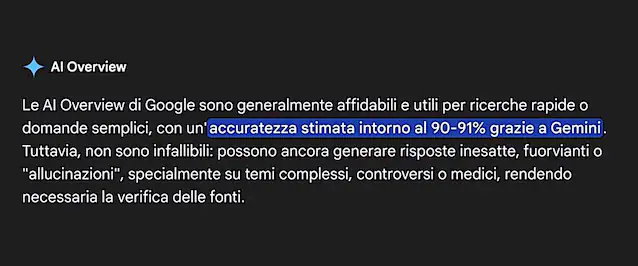

Når vi snakker om dette, lurte vi på om det «offisielle» svaret gitt av Google samsvarer med svaret generert av AI-oversikten. Og vet du hva vi oppdaget? Spør Google «Hvor nøyaktige er AI-oversiktssvarene», er dette svaret vi fikk.

Som du nettopp har lagt merke til, innrømmer Googles AI-oversikt selv å være nøyaktig i 90 % av tilfellene, og bekrefter dermed prosentandelen som fremkommer av studien utført av New York Times i samarbeid med Oumi. Dette er paradoksalt: Hvis den aktuelle studien faktisk viser seg å være unøyaktig, vil svaret gitt av Googles AI-oversikt også være unøyaktig, noe som viser at den kan påvirkes gitt kildene den får tilgang til på nettet.