Lykkes med skille en ekte video fra en som er generert av kunstig intelligens blir en stadig mer kompleks utfordring. De siste årene den såkalte dypfalskedet vil si at det syntetiske innholdet som imiterer virkelige mennesker, stemmer og situasjoner, har nådd nivåer av realisme som potensielt kan lure hvem som helst. I dag lar videogenereringsverktøy basert på maskinlæringsmodeller selv de med lite avanserte tekniske ferdigheter lage overbevisende videoer. Som et resultat sirkulerer kunstige videoer i økende grad på sosiale medier: de kan være morsomme klipp med imaginære dyr, men også falske taler fra kjendiser og offentlige personer eller, igjen, påståtte opptak av hendelser som aldri skjedde, ekte historiske forfalskninger som er kunstferdig laget for å generere feilinformasjon. I denne dybdeanalysen vil vi prøve å finne noen praktiske råd for å prøve å gjenkjenne videoer generert med AI. Vi snakker om å «prøve» fordi videoene generert med AI har nådd et slikt nivå av realisme at det ikke alltid er mulig å fastslå med full sikkerhet hva slags video som passerer under linsen vår.

Hvordan gjenkjenne en video laget med AI

Hva deepfakes er og hvorfor det blir stadig vanskeligere å gjenkjenne dem

For å forstå hvordan vi skal orientere oss i dette scenariet må vi først forstå hva vi snakker om. Med fristen dypfalskefusjon av engelske ord dyp læring (en avansert maskinlæringsteknikk) e forfalskningdet vil si falsk, er angitt videoer, bilder eller lyd generert gjennom algoritmer som imiterer utseendet eller stemmen til en ekte person. Disse systemene analyserer store mengder data for å gjengi ansiktsbevegelser, uttrykk og vokal klang med stor presisjon.

Selv om det inntil for et eller to år siden var mye lettere å identifisere den kunstige naturen til disse videoene, er ting annerledes i dag. Teknologien forbedres veldig raskt. Og de nyeste modellene kan lage høyoppløselige videoer med troverdig bevegelse, realistisk belysning og perfekt synkronisert lyd. Verktøy som Sora 2, utviklet av OpenAI, eller Veo 3, designet av Google, representerer emblematiske eksempler på denne utviklingen: de produserer klipp med høy visuell kvalitet og sammenhengende scener fra et narrativt synspunkt. Noen inkluderer funksjoner (som Sora 2s «Cameo») som lar deg bruke andres likheter og sette dem inn i nesten hvilken som helst AI-generert scene.

3 praktiske tips for å gjenkjenne videoer laget med AI

Nå som det er litt klarere hva en dypfalsk video er og hvordan den genereres, la oss se 3 tips for å gjenkjenne deepfakes laget med AI.

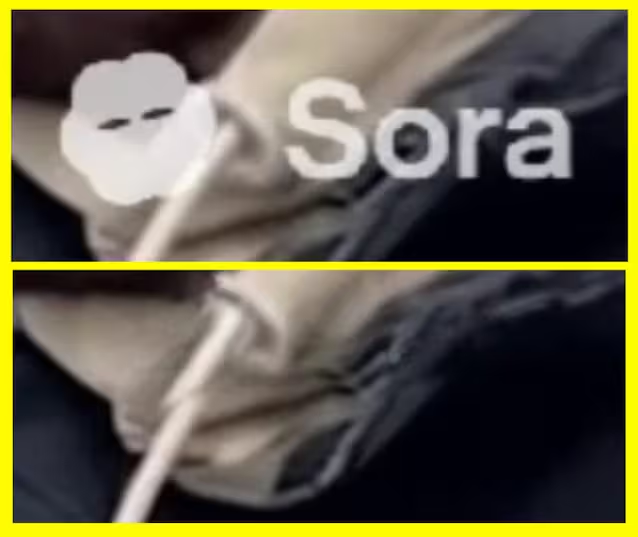

Identifiser tilstedeværelsen av et vannmerke

En første nyttig ledetråd kan være tilstedeværelsen av et vannmerkedvs. et grafisk skilt som automatisk brukes på innholdet. Noen plattformer inkluderer en logo eller symbol for å indikere at videoen ble laget med kunstig intelligens-verktøy. Når det gjelder innhold produsert med Sora, for eksempel, inkluderer videoer lastet ned fra appen et «sky»-ikon som beveger seg langs kantene på bildet. Det er en slags visuell etikett som indikerer opprinnelsen til innholdet. Men vær forsiktig: det er ikke en absolutt garanti. Hvis vannmerket er statisk, kan det kuttes ut og fjernes, og det er programvare som kan fjerne selv animerte (som Soras) med en håndfull klikk. Av denne grunn betyr mangelen på et vannmerke ikke nødvendigvis at videoen vi ser på er autentisk.

Analyser filmetadata

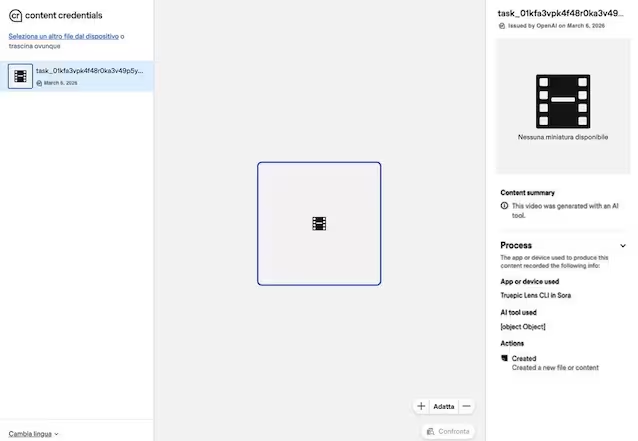

En mer teknisk metode er åanalysere filens metadata. Med dette ordet angir vi en hel rekke informasjon som automatisk følger med digitalt innhold når det lages. Metadata kan inkludere typen enhet som brukes, dato og klokkeslett for opptak, geografisk plassering eller programvaren som genererte filen. Noen videoer laget med AI-modeller inneholder spesifikke indikatorer som avslører deres opprinnelse. For eksempel «merker» Google innhold generert med AI-modellene med systemet SynthID. Når det gjelder videoer generert med Sora 2, er disse imidlertid merket med metadata C2PAsiden OpenAI (selskapet som utvikler Sora) er en del av Koalisjon for innholdsopprinnelse og autentisitet. Her er en miniveiledning om hvordan du kan verifisere metadataene i begge tilfeller.

- Besøk denne siden til ContentAuthenticity-side.

- Last opp filen du ønsker å bekrefte ved å klikke på Velg en fil fra enheten din eller ved å dra den inn i stiplet boks.

- Sjekk informasjon i høyre panel. Hvis innholdet er generert av AI, bør du se et sammendrag til høyre som ligner på det du ser i følgende eksempelskjermbilde.

Alternativt kan du last opp videoen til Gemini og spør Google AI om filmen inneholder SynthID-metadata.

Det er imidlertid greit å ha ett faktum i bakhodet: disse AI-deteksjonsverktøyene er ikke ufeilbarlige. Dette betyr at selv en AI-generert video kanskje ikke blir flagget som sådan av disse metadatadetektorene.

Gjennomfør en kritisk analyse av videoen

Ved siden av tekniske verktøy som de som er nevnt ovenfor, kan vi også stole påkritisk observasjon av videoen. I de mest sofistikerte deepfakes er det kanskje ikke lett å identifisere ledetråder som avslører den kunstige naturen til innholdet, men hvis videoen er ufullkommen og har noen mikrodefekter, kan identifisering av dem bidra til å vekke mistanker. Her er du 7 ledetråder du bør prøve å få øye på:

- Urealistisk lys eller skygger.

- For jevn hud.

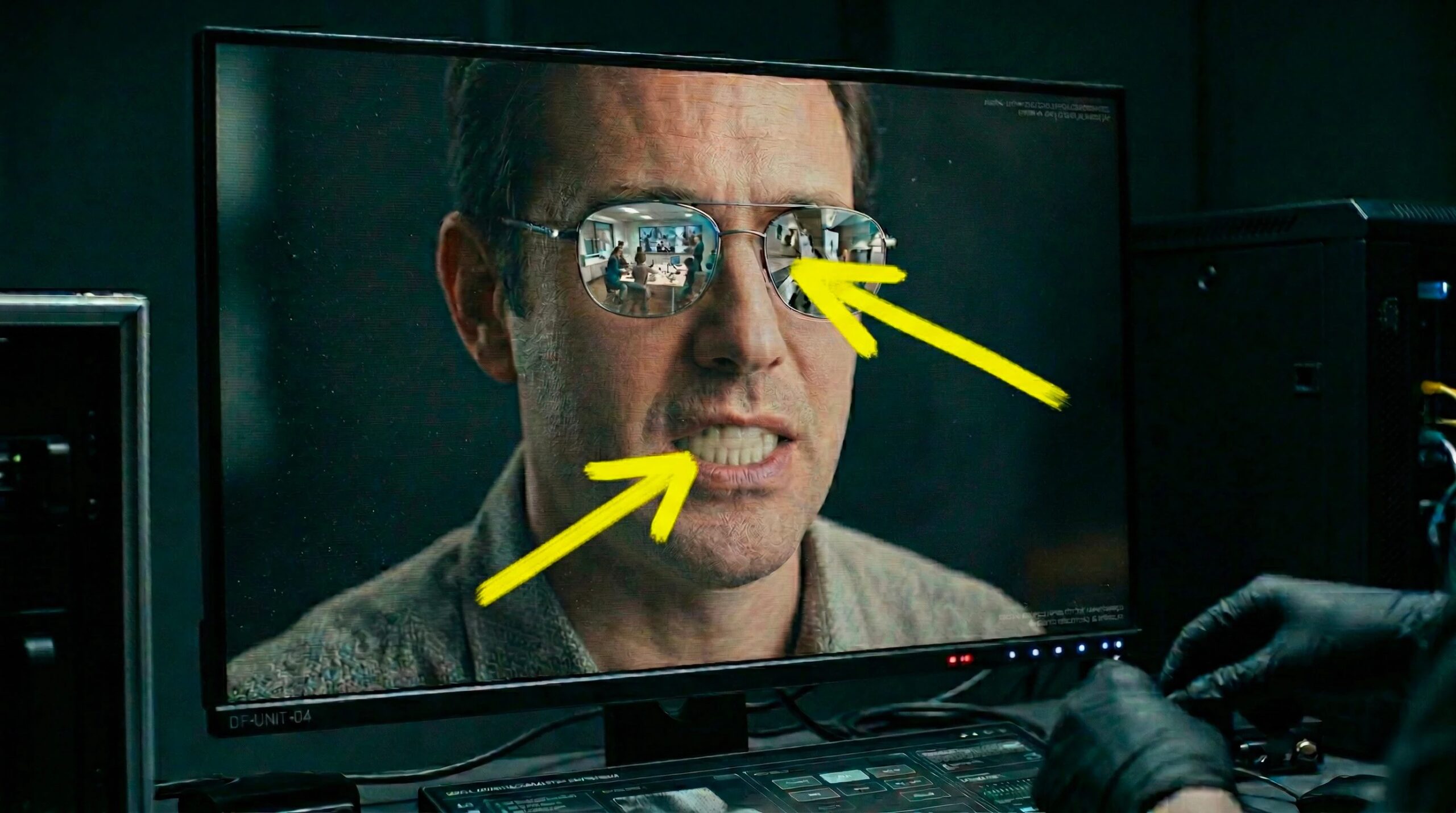

- Lett deformerte tenner eller øyne.

- Unaturlige refleksjoner på briller.

- Uregelmessig blinking.

- Rigide eller «flate» følelsesmessige uttrykk.

- Lyden er ikke perfekt synkronisert med leppebevegelser.

Naturlig disse tegnene er ikke alltid åpenbarespesielt i videoer generert med de mest avanserte teknologiene. Av denne grunn er det tilrådelig å integrere den visuelle analysen med analysen av metadataene (som allerede nevnt tidligere) og også med en verifisering av fakta og eventuelle erklæringer presentert i videoen som er gjenstand for analysen. Bare for eksempel, hvis videoen viser en politiker som kommer med visse uttalelser, kan søk på Google etter de eksakte setningene han uttalte tillate deg å finne treff eller ikke, noe som kan gi ytterligere ledetråder til opprinnelsen til innholdet. Denne verifiseringsprosessen, typisk for journalistisk arbeid, er fortsatt et av de mest effektive verktøyene selv for «vanlige» brukere.