Der Låsemodus av ChatGPT ble opprettet for å svare på et konkret sikkerhetsproblem som dukker opp når kunstig intelligens-systemer begynner å samhandle på en dyp måte med nettet og eksterne applikasjoner. Denne avanserte og valgfrie beskyttelsesmodusen designet for et lite antall høyrisikobrukere som drastisk reduserer muligheten for dataeksponering ved å strengt begrense AIs interaksjoner med omverdenen. Målet er å dempe en stadig mer relevant klasse av angrep, den såkalte rask injeksjonder en ondsinnet aktør forsøker å manipulere modellens oppførsel ved å få den til å følge uventede instruksjoner eller lekke sensitiv informasjon fra angrepne systemer.

Ved siden av låsemodusen kommer også nye etiketter «Høy risiko» som indikerer, direkte i grensesnittet, funksjonene som innebærer en mer delikat sikkerhetsprofil. La oss analysere det litt mer detaljert hvorfor disse verktøyene ble introdusert, hvordan de fungerer og hvordan de hjelper brukere og bedrifter med å ta mer informerte beslutninger om bruk av nettverkstilkoblet AI.

Hvordan låsemodus fungerer på ChatGPT

Når et AI-system kun kommuniserer med brukeren, er risikoomkretsen relativt kontrollerbar. Ting endres, og mye, når modellen kan navigere på nettet, søke etter eksterne tjenester eller handle via tilkoblede apper. I denne sammenhengen fenomenet rask injeksjon blir potensielt konkret. Med denne teknikken kan angripere utnytte eksternt innhold (for eksempel en nettside eller tilsynelatende uskyldige input) for å «injisere» instruksjoner designet for å lure modellen til å utføre uønskede handlinger, som om brukeren hadde gitt dem lovlig. Dette innebærer flere risikoer, inkludert potensiell dataeksfiltrering, det vil si uautorisert lekkasje av informasjon til tredjeparter (cyberkriminelle).

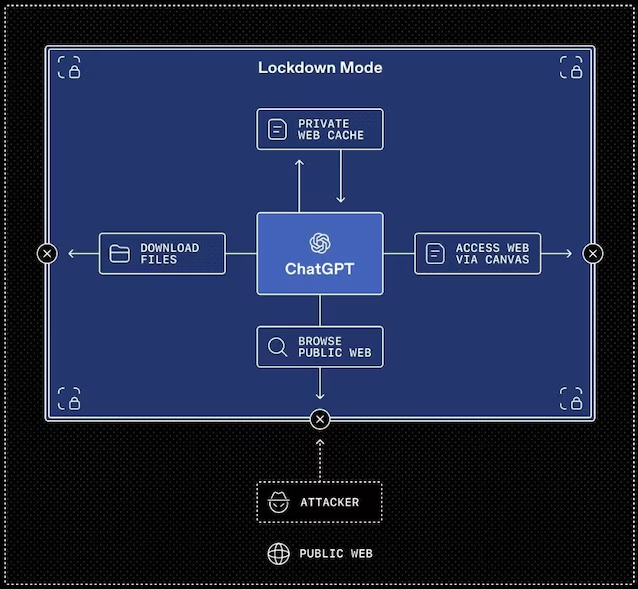

Der Låsemodus reagerer på dette scenariet med en deterministisk tilnærming, dvs. basert på rigide og forutsigbare regler. Ved å aktivere den, noen funksjoner i ChatGPT er begrenset eller deaktivert dersom sterk kontroll over dataflyter ikke kan garanteres. Et sentralt eksempel er Nettsurfing: I låst modus er tilgang til Internett begrenset til innhold som finnes i hurtigbufferen, og unngår nettverksforespørsler i sanntid mot nettet. Enkelt sagt betyr dette at det er mye mer komplekst for angripere å kunne få ut data og informasjon, og der dette garantinivået ikke er oppnåelig, er ChatGPT-nettlesingsfunksjonen ganske enkelt slått av.

Denne innstillingen den er ikke designet for den gjennomsnittlige brukerenmen for spesielt utsatte profiler som ledere, sikkerhetsledere eller team som administrerer kritiske data. Det er ingen tilfeldighet at Lockdown Mode er «podet» på beskyttelsen som allerede finnes i Enterprise-planene, som inkluderer teknikker som sandboxing (isolering av utførelse i kontrollerte miljøer), kontroller mot URL-basert eksfiltrering og overvåking og revisjonssystemer.

Den er i utgangspunktet tilgjengelig for brukere som har ChatGPT Enterprise, ChatGPT Edu, ChatGPT for helsetjenester Og ChatGPT for lærereog kan administreres av administratorer ved å opprette spesifikke roller og bruke ytterligere begrensninger utover standard retningslinjer. Når det gjelder utvidelsen av den nye sikkerhetsmodusen til alle andre brukere, sa OpenAI:

Vi planlegger å gjøre låsemodus tilgjengelig for forbrukerbrukere i løpet av de kommende månedene.

Et bemerkelsesverdig aspekt er den detaljerte kontrollen over tilkoblede apper. Fordi mange forretningsarbeidsflyter er avhengige av eksterne integrasjoner, kan administratorer bestemme nøyaktig hvilke applikasjoner og handlinger som er tillatt når låsemodus er aktivert.

Den får også merket «Høy risiko» for sikkerhet

Ved siden av låsemodusen kommer en annen viktig brikke: den systematiske introduksjonen av«Høy risiko»-etikett for noen funksjoner som, selv om de er nyttige, utvider angrepsoverflaten. Funksjoner som krever tilgang til nettverket eller eksterne ressurser rapporteres konsekvent på tvers av ChatGPT, ChatGPT Atlas og Codex, ledsaget av klare forklaringer på hvilke endringer og hvilke risikoer som introduseres.

Målet er å umiddelbart avklare når en spesifikk funksjon innebærer en større risiko for sikkerheten: som rapportert av OpenAI, men disse etiketter er ikke definitive og kan fjernes over tid.